Jahrzehntelang haben wir von Hand programmiert. Manchmal unterstützt von Case-Tools und Code-Generatoren, aber ohne tiefes Verständnis und permanente Tuchfühlung mit dem Code ging es nicht.

Daran hat auch die erste Generation der AI Chat-Bots nichts geändert. Alles nur Spielkram. Vibe-Coding führt schneller zu ganz kleinen Systemchen und danach noch schneller in den Sumpf.

Die Revolution kam im Sommer 2025 mit dem Einzug der AI Coding Assistenten in den Desktop des Software-Ingenieurs. Das ist keine weitere Hype-Welle, sondern schlichte Disruption.

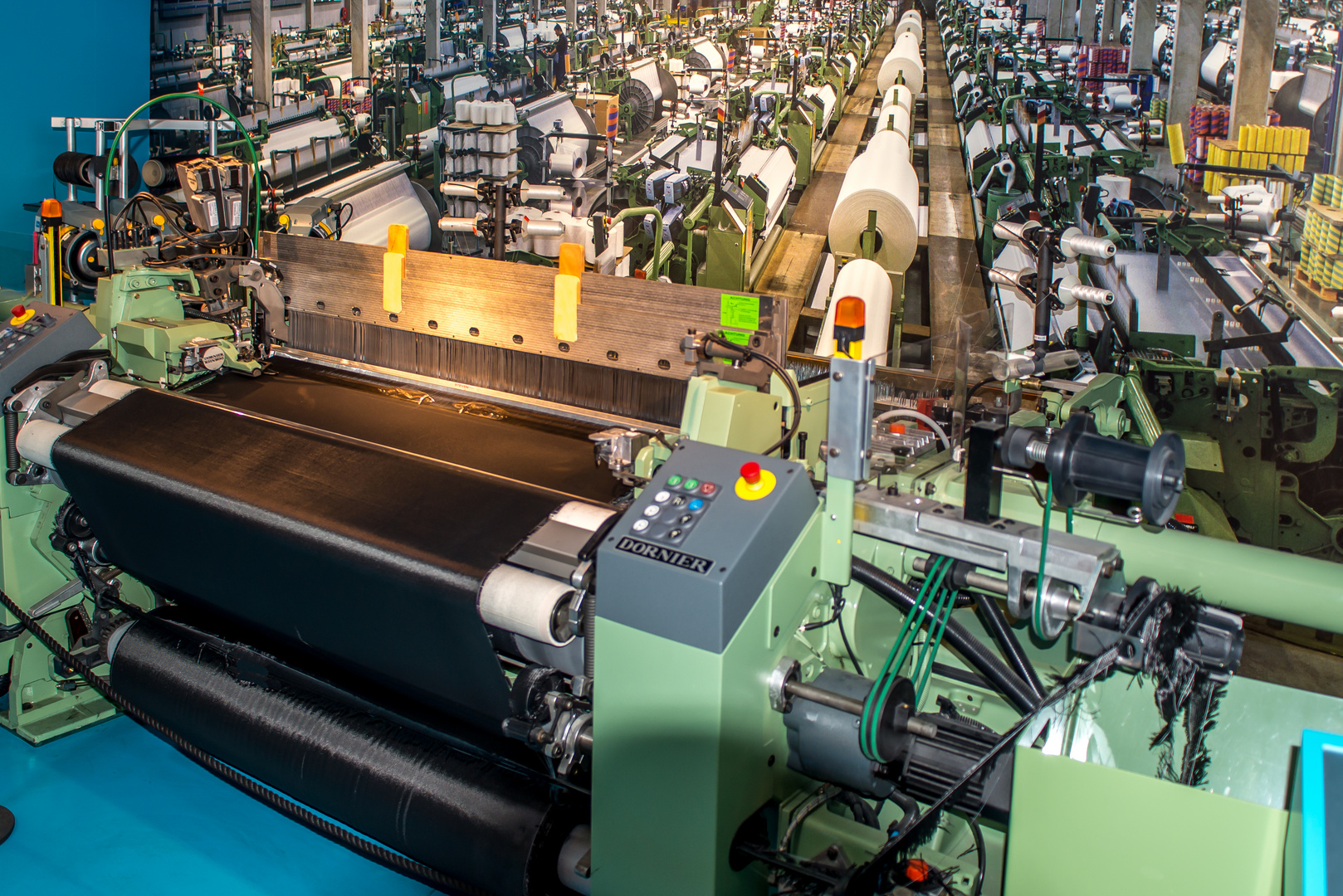

Die Arbeit des Informatikers ändert sich massiv. Wir Software-Handweber müssen lernen, mit einem mechanischen Webstuhl umzugehen. Allerdings: Dampfmaschinen und Webstühle mussten Stück für Stück einzeln gebaut werden. Ein Coding Agent wie Claude nutzt die vorhandenen Ressourcen des Entwickler-PCs und eine Server-Farm an der amerikanischen Westküste. Es ist so, als hätte James Watt 1769 alle Dampfmaschinen des Erdballs gleichzeitig gebaut.

Das glaube ich nicht – Ich mag keine Übertreibungen!

Ich habe Verständnis für diese Haltung. Aber sie ist rückwärtsgewandt, beruht auf mangelnder persönlicher Erfahrung oder auf der Angst vor persönlicher Kränkung, weil durch die KI die Hälfte des Wissens und Könnens eines Informatikers plötzlich überflüssig ist.

Wenn man sich vollständig auf die Benutzung der neuen KI Werkzeuge einlässt, kann man mit ihnen großartige Ergebnisse erzielen. Tut man es widerwillig, skeptisch , gedankenlos, kann man mühelos die eigene Skepsis bestätigen. Mein Rat ist ein anderer: Bringen Sie dem KI-Assistenten die Wertschätzung entgegegen, die sie einem talentierten Jung-Informatiker entgegenbringen würden. Das ist ein nüchterner Rat – er hat nichts mit Anthropomorphisierung zu tun. Behandeln Sie die KI wie Ihren Hund, dann wird sie Stöckchen bringen. Behandeln Sie sie auf Augenhöhe – und Sie haben die Chance, von ihr zu lernen.

Das funktioniert höchstens für kleine Systeme!

Wer mit einem KI Assistenten Software entwirft, kennt das Problem, dass der Gesprächskontext begrenzt ist. Ein System mit 5.000 Codezeilen passt vielleicht gerade noch hinein, aber kommerzielle Systeme fangen eher bei 50.000 Zeilen an. Auch 5.000.0000 Lines of Code kommen vor.

Aber: Das System als Ganzes muss nicht in einen KI Gesprächskontext passen! Die KI kann uns wunderbar unterstützen, auch wenn sie nur bestimmte Ausschnitte kennt. Unser Job ist es, Teilaufgaben zu definieren und den zugehörigen Kontext so festzulegen, dass die AI zuverlässig arbeitet und nicht heute Teile dessen korrumpiert, was wir gestern mit ihr gebaut haben. Kurz: Es ist nicht anders, als in einem menschlichen Entwicklungs-Team.

Den Tiger reiten

Ich spreche aus eigener Erfahrung über den Bau eines Softwaresystems mit mehr als 100.000 Lines of Code. Um dieses System auf klassische Weise zu spezifiziueren, zu bauen und zu dokumentieren, wären mindesten 10 Personenjahre notwendig gewesen, bei einer geschätzten Dauer von zwei Jahren.

Das System tut exakt, was es soll, es enthält weniger Fehler, als wenn man es traditionell entwickelt hätte, es enthält etwas mehr an Redundanz, ist aber dafür besser dokumentiert. Mehr dazu in einem separaten Artikel über die Rapid Application Platform.

Erfahrungen

Es fühlt sich so an, als ob man einen sehr fleißigen und komptenten Mitarbeiter hat, der im Detail sorgfältig arbeitet, aber mit seiner Ingenieurs-Rolle zufrieden ist. Er schafft mehr als fünf menschliche Kollegen, wenn man ihn umsichtig instruiert. Man kann ihm beim Denken zuschauen und erfährt so, ob er auf dem richtigen Weg ist. Man kann jederzeit lenkend eingreifen. Man ist die meiste Zeit damit beschäftigt, sich auf die fachlichen Inhalte der Anwendung zu konzentrieren. Wichtig ist, gößere Veränderungen mit einer Planungsphase zu beginnen. Man muss das Ergebnis, also den Umsetzungsplan, sorgfältig kontrollieren; ist der Plan gut, wird die Umsetzung fast immer fehlerfrei und zügig erfolgen. Ist man zu vertrauensselig, kann es passieren, dass die KI "übermotiviert" und planlos Lösungen produziert, die durchaus funktionieren, aber genau den Keim der Stukturverschlechterung in sich tragen, den wir von menschlicher Systemwartung nur allzugut kennen.

Man kann der KI beibringen, sich selbst zu beaufsichtigen: Bei der Entwicklung von RAP habe ich die AI gebeten, Tools zu bauen, welche die Einhaltung meiner Architekturziele durch Code-Analyse überwachen. Zugegeben, es gab auch ein paar zähe Re-Factoring Sessions. Aber nie ist etwas für länger als eine Stunde kaputtgegangen – und so wuchs das Vertrauen stetig.

Es ist, als ob man die sprichwörtlichen Sieben-Meilen-Stiefel anhätte.

Und manchmal ist es zum Haare-Raufen, weil man so viel mehr an Kontext selbst im Kopf behalten muss, um den Fokus des Assistenten immer neu zu justieren. Auch, weil man emotional die totale Abhängigkeit spürt, die man auf der Coding-Ebene eingeht.

Es gibt schöne Momente, in denen man erlebt, dass der Agent eine Idee konsequent zuende denkt, die man selbst nur halbfertig im Kopf hatte. Es gibt entspannte Phasen, weil man sieht, dass die AI Fehler macht, identifiziert und behebt, selbständig Testfälle konstruiert und durchspielt.

Und es gibt Überraschungen, weil man merkt, wie befreit man plötzlich Aufgaben angehen kann, deren technische Umsetzung anspruchsvoll, mühselig oder undankbar ist.

Wie bewältigen wir die Umstellung?

Wir müssen alle lernen, diese neue Technologie effizient und sicher einzusetzen, vom Professor bis zum Studenten, vom CIO bis zum Juniorprogrammierer. Ich habe mit einem früheren Kollegen zusammen ein Paper über die Disruption in der IT-Ausbildung verfasst. Der nächste Schritt wird sein, die dort skizzierten neuen Lehrkonzepte auszuprobieren und die Erkenntnisse daraus zu publizieren. Unter dem Acronym AIDE (Artificial Intelligence for Development Engineers) stelle ich ergänzendes Material auf github bereit.

Es hat ein wenig den Charakter einer "Stunde Null" für die Informatik, aber natürlich gehen nicht alle mit den gleichen Voraussetzungen an den Start. Wer "noch in der alten Zeit" gelernt hat, weiß, dass er jederzeit bis zum letzten Statement oder Pattern analysieren kann, was die AI fabriziert hat. Das gibt Souveränität. Die nächste Generation an Softwerkern wird anders agieren müssen.

Aber: Wer von uns "Alten" versteht etwas von der Halbleiter-Chemie, vom Chip-Layout, vom Schaltplan des Motherboards, von den Innereien des Betriebssystems, vom Assembler, vom P-Code, auf dem wir mit unserer Anwendung sitzen?

Next Level!

Mein Fazit: Es kommt im Prinzip ein weiterer Layer dazu, der aber qualitativ anders ist, weil er eine inhärente Unschärfe enthält. Ein AI Agent ist eben kein Compiler, sondern ein mündiger Erfüllungsgehilfe. Mann tut oft gut daran, nicht sofort prozedural etwas von ihm zu verlangen. Oft ist es klüger, einen Sachverhalt zu schildern, ein Ziel zu umreißen, ein Unbehagen zu artikulieren. Mehrmals habe ich erlebt, das Resultate am Ende besser werden, wenn ich mich mehr zurücknehme in der Explorationsphase.

Mamchmal aber musste ich mit aller Kraft eingreifen, um sublime Fehlentwicklungen zu bekämpfen. Es gab etliche Momente, wo ich absolut an der Grenze meiner persönlichen Fähigkeiten operiert habe. Das hat mir gezeigt, wie schnell eine Anwendung jenseits von ca. 50.000 LoC degenerieren kann, wenn der Mensch nicht auf der Hut ist.

Wir können ab sofort mit weniger Input und zehnfacher Geschwindigkeit vergleichbaren Output erzeugen wie bisher. Damit die neue erste Schicht der Übersetzung zuverlässig arbeitet, müssen wir einen – mitunter auch mehrere – Agenten detailliert instruieren, ihnen Intentionen mit auf den Weg geben und Verbotstafeln aufstellen. Dazu wird Mehr und Anderes benötigt, als das, was man heute "Prompt-Engineering" nennt. Es ist eine spannende Zeit für Informatiker. Persönlich empfinde ich es als ein Privileg, nach vier Jahrzehnten traditioneller Arbeit zu erkennen, welches Tor sich hier auftut. Viele von uns werden früher oder später hindurchgehen ..